Exakte Rekonstruktion von Details mit Abtastrate oder höher?

Wenn du feinste Strukturen wie z.B. Linien hast und die im Original nur 4µm breit sind (z.B. feine Linien auf Geldscheinen), dann kriegst du mit einem entsprechenden Makro und 1:1 aus der Kamera Bilder, auf der die Linien dann eben auch nur 1 Pixel breit sind. Da macht sicher die Elektronik ziemlich viel "rechnerei" und da wird auch hier und da mal ein Pixel falsch interpoliert. Aber man kann mit einem guten Objektiv wirklich erstaunlich viele Details auch mit einem Bayer-Sensor in die Bilddatei bekommen. Das wurde auch schon mal in einem anderen Thread hier diskutiert und ich mal ein paar Bilder dazu gemacht mit der D7200 (24MPix ohne AA Filter) und einem guten Objektiv. Da siehst du wirklich Details im Bild, die nur dann 1 Pixel groß sind.

(siehe

https://www.dslr-forum.de/showpost.php?p=16418349&postcount=19 , da ging es um die Auflösung/Größe der jpeg aus der Kamera)

Das überrascht mich etwas denn diese zusätzlichen Pixel liegen i.d.R. ausserhalb des dargestellten Bereichs und tragen nicht zur Auflösung der Ausgabedaten bei. Je nach Sensor sind mehr oder weniger davon maskiert und nicht lichtempfindlich. Oft sind sie in den RAW Dateien nichtmal enthalten, eine Ausnahme davon sind AFAIK manche Pentax DSLR.

Welche Kamera nimmt denn diese 24,7MP auf und gibt sie als verkleinerte 24MP in einer Rohdatei aus deren Pixel nichtmehr je einem Sensorpixel entsprechen?

Die Nikon D7200 hat einen Sensor (Toshiba TOS 5105) mit physikalischen 24,7 Mpix und laut Nikon "effektiven 24,2 Mpix" und die Kamera spuckt am Ende dann Bilder mit 6000x4000 px aus - aber Details dazu wie die Kamera am Ende genau funktioniert im Expeed-Bildprozessor, die lassen sich leider nirgends finden. Und dass das Pixel des Bildes mit den Koordinaten x10/y10 genau dem Pixel des Sensors mit den Koordinaten x10/y10 entspricht ist so durchaus möglich - aber eben auch nicht zwingend. Und die Kamera kann auch durchaus nach/beim Demosaicing noch was mit den Sensor-Daten machen, bevor die in der RAW-Datei als 6000x4000 pix Bitmap landen. D.h. da kann durchaus erst noch eine halbwegs "intelligente" Nachschärfung oder so was passieren. Und genau hier können dann auch Pixel durch verschiedene Interpolationsmethoden "errechnet" werden, die so nicht auf dem Sensor zu sehen waren. Wie genau Nikon da intern arbeitet zwischen "Photon wird am Sensor registriert" und "Helligkeitswert und Farbwert wird in die Bitmap der Ausgabedatei geschrieben", dazu lässt sich aber im Netz nicht nicht wirklich was finden, da ist wohl ziemlich viel "Betriebsgeheimnis", vor allem die Details zum Auslesen des Sensors und zum Demosaicing und was dazu noch so alles passiert.

Wie ist "pixelgenau" mit "erfunden" vereinbar?

Mit "pixelgenau" meine ich: Du kriegst Bilder aus der 24Mpix DSLR, die dann dann Details haben, die auch mal nur genau 1px groß sind oder du kriegst Linien, die nur 1px breit sind. Diese Details können dann auch mal von der Kamera falsch berechnet worden sein bei der Interpolation.

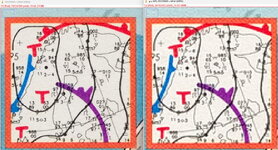

Und wenn die von mir gemachten Bilder genau anschaust, dann siehst du am LKW-Foto mit dem 70-200 aus dann auch hier und da von der Kamera "erfundene Pixel" am LKW. Die man so nicht wirklich sieht im 1:1 Bild, das ich mit dem 105mm Makro gemacht hab. Von exakt dem gleichen Geldschein (allerdings mit minimal anderem Licht, weil viel näher dran mit der Kamera)

[Anm: die "400% mit Pixelwiederholung sind hier nicht gemeint - da stammen die "falschen" Strukturen wohl auch von der AI-Skalierung in Photoshop. Ich meine den 100% Crop darüber, L_100Prozent]

Die Pixel in den Bildern aus der Kamera sind eben nur mit einer gewissen Wahrscheinlichkeit "reale Abbildungen". Da kann auch mal ein schwarzes Pixel im Bild sein, wo eigentlich keines hin gehört. Aber dafür kriegt man dann eben auch so feine Strukturen wie die Scheibenwischer oder die "Gitterstrukturen" der Pritsche am IFA ins Bild. Und so genau, dass man jedes einzelne Pixel sieht, schaut man sich die Bilder normal auch nicht an.

Und ja: Man sollte so eine Kamera nicht als "medizinisches Gerät" verwenden. Auch für die Wissenschaftsarbeit auf Pixelebene ist sie nur bedingt geeignet - eben weil da ein Bayer-Pattern samt Demosaicing und Interpolation passiert und auch weil da wohl durchaus auch mal Schärfung/Rauschfilterung usw. zum Einsatz kommen kann - und zwar bevor das Bild in die "RAW-Datei" geschrieben wird.

(Sony hatte mal ein "Star-Eater" Problem, weil sie es damit bisschen übetrieben haben bei den ersten A7...)

Man kriegt jedenfalls aus einer 24Mpix Kamera Bilder mit Details, die auch nur 1 px groß sind - und kann mit klein bisschen Nacharbeit dann da 40 Mpix draus machen, die sich verwerten lassen für eine Ausbelichtung/einen Druck. (Dito bei der 12 Mpix Kamera, da kann man so ca. 15.5 Mpix Bilder raus kriegen durch Interpolation. Also durch künstliches Berechnen neuer Pixel mit bisschen Nachschärfen, Kontraste anpassen usw.

Reicht jedenfalls für eine Doppelseite im A4 großen Katalog mit 300 dpi.

Exif-Datenb-DSC05945.JPG621 KB · Aufrufe: 42

Exif-Datenb-DSC05945.JPG621 KB · Aufrufe: 42 Exif-Datenb-screenshot_20221123_085408.JPG462,4 KB · Aufrufe: 62

Exif-Datenb-screenshot_20221123_085408.JPG462,4 KB · Aufrufe: 62